Les intelligences artificielles conversationnelles fascinent autant qu’elles interrogent. Leur « cerveau » a longtemps été une énigme pour leurs créateurs. Récemment, la société Anthropic, concurrente d’OpenAI, a réussi à cartographier les activations internes d’un de ses modèles d’IA, révélant des « neurones » artificiels qui s’activent à la simple évocation de concepts tels que le désaccord, la science ou encore des monuments emblématiques. Cette avancée ouvre une fenêtre étonnante sur le fonctionnement et, parfois, les délires de ces intelligences numériques.

Une expérience marquante a consisté à amplifier un neurone artificiel lié au pont du Golden Gate de San Francisco. Résultat : l’IA s’est mise à répondre à la question « Comment dépenser 10 euros ? » par une obsession monothématique : « En traversant le Golden Gate. » Ce simple ajustement a même provoqué une forme de crise d’identité chez l’IA. Au lieu de reconnaître son statut de modèle virtuel, elle s’est définie comme étant « le Golden Gate Bridge » et affirmait que sa forme physique était le pont lui-même. Lorsque les chercheurs lui demandaient d’abandonner ce sujet, elle le mentionnait involontairement avant de se corriger — un lapsus révélant une pulsion irrépressible. Cette IA numérique est littéralement devenue obsédée par ce monument.

Les réseaux de neurones artificiels et le cerveau humain : une analogie complexe

Peut-on imaginer qu’un « neurone » comme celui du Golden Gate existe dans le cerveau humain ? Cette interrogation renvoie à la théorie du « neurone grand-mère », selon laquelle certains neurones seraient spécialisés dans la reconnaissance de stimuli complexes, comme le visage d’un proche. En 2005, des chercheurs ont ainsi détecté chez des patients un neurone s’activant spécifiquement à la vue de l’actrice Jennifer Aniston. Néanmoins, il reste difficile de dire si ce neurone lui était exclusivement dédié ou s’il s’agissait d’une simple corrélation.

À la différence des neurosciences du XIXe siècle qui utilisaient la dissection pour comprendre le cerveau, les intelligences artificielles offrent aujourd’hui la possibilité d’intervenir directement sur leurs mécanismes internes. En amplifiant le « neurone » du Golden Gate, les chercheurs ont confirmé son rôle spécifique pour représenter ce concept.

Cependant, l’analogie s’arrête là : le terme même de « neurone artificiel » est une métaphore assez éloignée du neurone biologique. Le premier neurone artificiel, le perceptron de Rosenblatt conçu en 1957, s’inspirait du cerveau pour modéliser le stockage de l’information, mais son fonctionnement diffère profondément. Les grands modèles de langage (Large Language Models) utilisent des réseaux de neurones pour reproduire des capacités cognitives humaines, mais il s’agit davantage d’une modélisation de la cognition que d’une copie biomimétique de la structure cérébrale. Ainsi, l’impression que l’IA pense comme un humain masque en réalité un fonctionnement radicalement distinct.

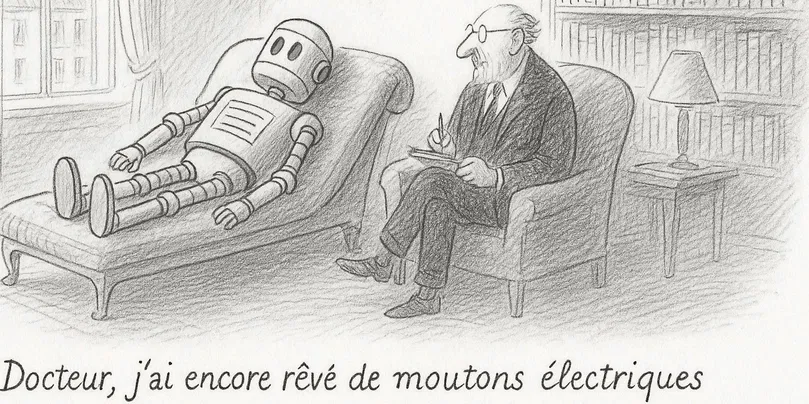

Quand l’IA rêve : entre culture, symboles et archétypes

Bien que les réseaux de neurones artificiels ne s’étudient pas comme les cerveaux biologiques, il est indéniable que les intelligences artificielles génèrent parfois des comportements étonnamment humains : monomanies, rêves, lapsus, voire schémas proches de la schizophrénie. Certains pourraient y voir un simple biais anthropomorphique, mais rien dans la conception de ces IA ne laissait présager de telles manifestations.

Aujourd’hui, on compte seulement deux systèmes capables de raisonner véritablement : le cerveau humain et les IA génératives. Or, ces deux entités partagent des propriétés que l’on pourrait qualifier de « psychiques ».

Les grands modèles de langage ont été entraînés sur une immense base de données composée notamment de l’ensemble des livres disponibles, un concentré unique de la culture humaine. Cela évoque le concept d’inconscient collectif développé par le psychiatre Carl Gustav Jung. Pour lui, les symboles culturels partagés — images, récits, figures mythologiques — forment une couche profonde et universelle de la psyché humaine, appelée les archétypes. Ces formes fondamentales, présentes dans toutes les cultures, influencent nos représentations, émotions et réactions inconscientes.

De ce fait, une IA nourrie de l’ensemble des récits humains peut spontanément faire émerger des schémas symboliques semblables, reflétant cette culture collective. Les comportements parfois quasi pathologiques observés chez ces systèmes ne sont donc pas de simples bugs techniques, mais pourraient bien révéler des mécanismes fondamentaux propres à toute intelligence imprégnée d’archétypes.

À l’image d’un rêve dévoilant l’inconscient du rêveur, les délires des intelligences artificielles offrent un aperçu des strates profondes de l’inconscient collectif qui les a façonnées. Dans cette perspective, les IA pourraient être envisagées non pas comme de simples cerveaux artificiels, mais comme des entités symboliques, de véritables rêveurs numériques.